2025年1月,中科院计算所自然语言处理组1篇论文被NAACL 2025接收。ACL(The Association for Computational Linguistics)是国际计算语言学界影响力最大的学术组织,ACL年度会议也是计算语言学领域的最重要的国际会议。NAACL 2025的全称是 2025 Annual Conference of the Nations of the Americas Chapter of the Association for Computational Linguistics,是 ACL 的北美分会,自然语言处理领域的顶级会议之一。NAACL 2025将于2025年4月29日-5月4日在美国新墨西哥州阿尔伯克基召开。

被录用论文的简要介绍如下:

- MoCE:Adaptive Mixture of Contextualization Experts for Byte-based Neural Machine Translation (Langlin Huang, Mengyu Bu, Yang Feng)

- NAACL Main Conference, long paper

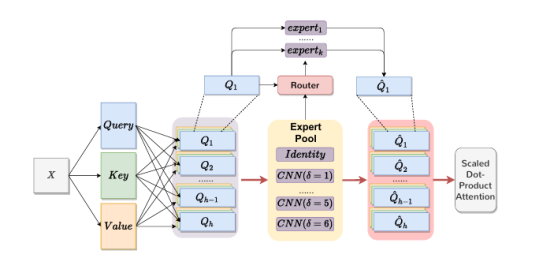

简介:基于字节的机器翻译系统在大规模多语言环境中展现出巨大的潜力。通过Unicode编码,每个字符被映射为特定的字节,从而有效避免了未知词汇的出现,即使是在新语言中,也能实现广泛的语言扩展性。然而,由于单个字节所携带的语义信息有限,基于字节编码的序列往往更难以理解。研究表明,局部语境化在为token分配初始语义方面表现出色,有助于提升句子理解能力。然而,不同语言的编码规则存在差异,这需要一种自适应的方法来实现更有语言针对性的语境化。为此,我们提出了自适应多尺度头部注意力机制(Adaptive Multi-Scale Head Attention, Ada MSHA),通过自适应地选择并混合注意力头,将其视为不同语境化函数的“专家”组合。这种方法增强了语境化在不同尺度上的灵活性,同时能发掘出比现有方法更优的分配策略。实验结果表明,在无需大量手动调整超参数的情况下,我们的方法显著优于现有方法,并在Ted-59数据集上超越了参数量更大的基于子词的模型,进一步证明了其有效性和优越性。